研究表明,到 2026 年,超过 80% 的企业将利用生成式 AI 模型、API 或应用程序,而目前这一比例还不到 5%。

这种快速采用引发了有关网络安全、道德、隐私和风险管理的新考虑。在当今使用生成式 AI 的公司中,只有 38% 的公司能够缓解网络安全风险,只有 32% 的公司致力于解决模型不准确的问题。

我与安全从业者和企业家的对话集中在三个关键因素上:

- 企业生成式人工智能的采用给安全挑战带来了额外的复杂性,例如过度特权的访问。例如,虽然传统的数据丢失防护工具可以有效地监视和控制流入人工智能应用程序的数据流,但它们通常无法处理非结构化数据和更微妙的因素,例如道德规则或提示中的偏见内容。

- 对各种 GenAI 安全产品的市场需求与应用程序所采用的底层用例的 ROI 潜力和固有安全漏洞之间的权衡密切相关。随着人工智能基础设施标准和监管环境的不断发展,机会与风险之间的平衡不断发展。

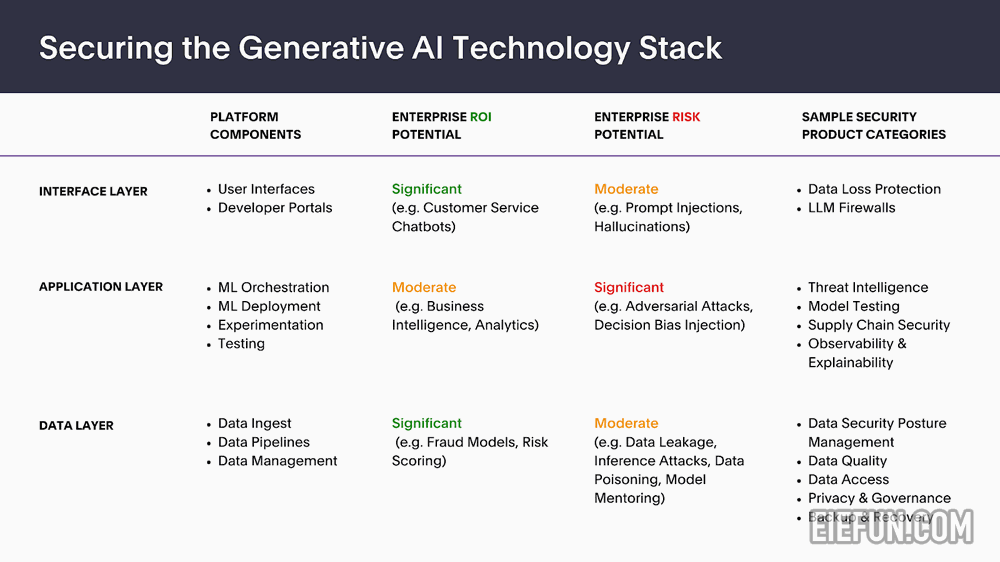

- 与传统软件非常相似,生成式人工智能必须在所有架构级别上得到保护,特别是核心接口、应用程序和数据层。以下是技术堆栈中各种安全产品类别的快照,重点介绍了安全领导者认为具有显着投资回报率和潜在风险的领域。

GenAI 聊天机器人的广泛采用将优先考虑在不影响用户体验的情况下准确、快速地拦截、审查和验证输入和相应输出的能力。

接口层:平衡可用性与安全性

企业看到了利用面向客户的聊天机器人的巨大潜力,特别是根据行业和公司特定数据训练的定制模型。用户界面很容易受到提示注入的影响,这是一种旨在操纵模型响应或行为的注入攻击的变体。

此外,首席信息安全官 (CISO) 和安全领导者面临着越来越大的压力,要求在其组织内启用 GenAI 应用程序。虽然企业的消费化一直是一个持续的趋势,但像 ChatGPT 这样的技术的快速和广泛采用引发了前所未有的、由员工主导的在工作场所使用这些技术的动力。

GenAI 聊天机器人的广泛采用将优先考虑在不影响用户体验的情况下准确、快速地拦截、审查和验证输入和相应输出的能力。现有的数据安全工具通常依赖于预设规则,从而导致误报。 Protect AI 的 Rebuff 和 Harmonic Security 等工具利用 AI 模型来动态确定通过 GenAI 应用程序的数据是否敏感。

免责声明

本文内容(图片、文章)翻译/转载自国内外资讯/自媒体平台。文中内容不代表本站立场,如有侵权或其它,请联系 admin@eiefun.com,我们会第一时间配合删除。